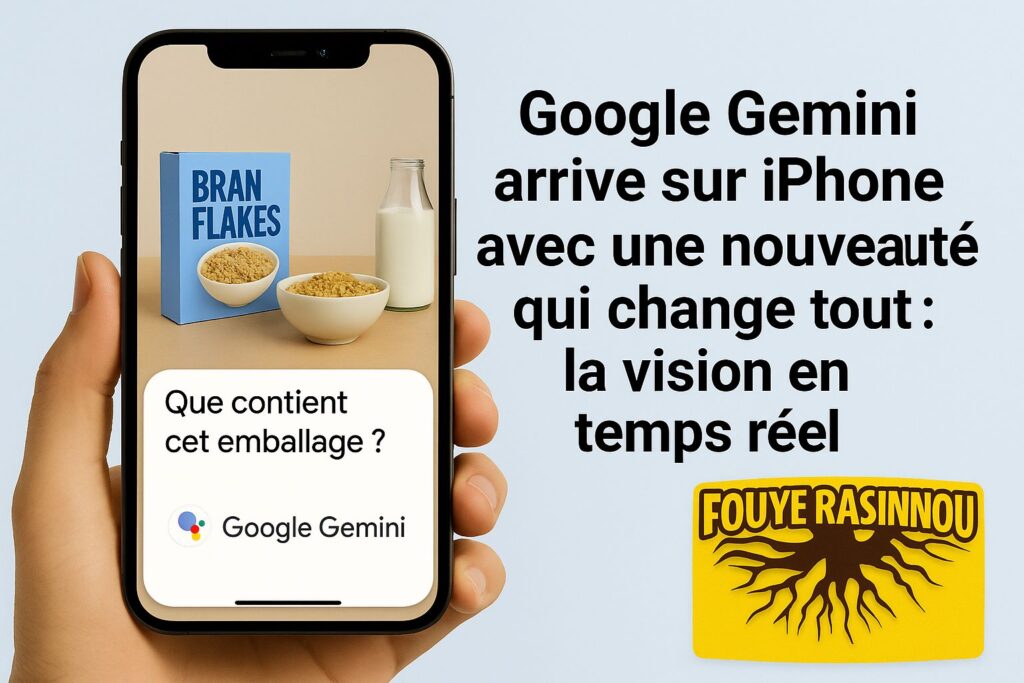

Un tournant discret mais fondamental vient de s’opérer dans la relation entre l’humain et la machine. Avec l’arrivée de Gemini Live sur les appareils Apple, Google dépasse une nouvelle frontière : celle de la vision assistée en temps réel, directement depuis la caméra ou l’écran de votre iPhone. Une fonctionnalité qui, à première vue, semble anodine, mais qui annonce un futur où l’intelligence artificielle ne se limite plus à écouter, mais observe, comprend et guide.

L’assistant vocal devient un compagnon visuel

Jusqu’ici, interagir avec une IA signifiait surtout parler ou écrire. Désormais, vous pouvez montrer. Grâce à deux nouvelles options, « partager la caméra » ou « partager l’écran », disponibles dans l’application Gemini, il est possible de pointer votre téléphone vers n’importe quel objet ou scène… et de recevoir une réponse immédiate. Besoin d’identifier une plante, de comprendre une notice écrite en japonais ou de déchiffrer un panneau en pleine randonnée ? Il suffit de demander à voix haute. L’assistant lit, interprète, explique. Comme si un guide invisible, ultra-savamment informé, se glissait dans votre poche.

Une ouverture stratégique sur iOS

Ce qui frappe, au-delà de la prouesse technique, c’est la générosité de l’offre : cette technologie est accessible à tous, sans frais. Contrairement à d’autres plateformes qui réservent des fonctions similaires à leurs abonnés premium, Google choisit l’ouverture. Une manière non dissimulée de marquer son territoire face à ChatGPT, dont les capacités visuelles sont encore cloisonnées aux formules payantes.

En agissant ainsi, Google place un jalon important dans la démocratisation de l’assistance visuelle intelligente. Il ne s’agit plus seulement d’impressionner, mais d’infiltrer le quotidien.

Une étape vers les lunettes intelligentes

Cette mise à jour s’inscrit dans une trajectoire plus ambitieuse : celle du Projet Astra, un chantier d’envergure dans lequel Google développe des lunettes connectées nourries à l’intelligence artificielle. Ces lunettes seront capables de comprendre l’environnement, d’analyser les images, de dialoguer avec l’utilisateur. En d’autres termes, Gemini Live sur iPhone n’est pas un aboutissement, mais un terrain d’essai. L’expérience utilisateur récoltée aujourd’hui façonnera la fluidité des interactions demain.

Vers une nouvelle ère d’interaction

Il ne faut pas s’y tromper : cette fonctionnalité n’est pas une simple mise à jour. Elle illustre un basculement. Le smartphone, longtemps au centre de notre univers numérique, commence à s’effacer derrière des interfaces plus naturelles, plus transparentes. La voix, la vue, le geste : voilà les langages du futur. Et Google, en donnant une vue à Gemini, injecte un peu plus d’intelligence dans le monde qui nous entoure.

L’intelligence artificielle cesse d’être un outil froid pour devenir un interlocuteur sensible, capable d’interpréter les images et les intentions. Et ce n’est plus de la science-fiction : il suffit d’ouvrir Gemini sur votre iPhone pour toucher du doigt cet avenir.

📍Version requise : Gemini 1.2025.2062302 ou plus récente. Mettez à jour, relancez, et laissez-vous voir.

Fouye Rasin Nou(FRN),29 juin 2025